Neue AI-Angriffsvektoren

Wer beim Implementieren neuer Pipelines und Umgebungen nicht auf einheitliche, infrastrukturweite Transparenz achtet, macht die eigene Infrastruktur möglicherweise anfällig für neue Angriffe.

Neue AI-Angriffsvektoren

Wer beim Implementieren neuer Pipelines und Umgebungen nicht auf einheitliche, infrastrukturweite Transparenz achtet, macht die eigene Infrastruktur möglicherweise anfällig für neue Angriffe.

Modellwildwuchs

AI-Modelle sollten systematisch in einem Katalog erfasst werden, um Schatten-AI-Modellen, Complianceverstößen und der Datenausschleusung durch AI-gestützte Anwendungen vorzubeugen.

Unzureichende Governance

Neue Gesetze und Vorschriften verlangen strikte Kontrollmaßnahmen rund um die Nutzung von AI-gestützten Anwendungen und von Kundendaten, die in diese eingespeist werden.

Schöpfen Sie die bahnbrechenden Vorteile von KI und Large Language Models (LLMs) voll aus, ohne Ihre Infrastruktur zu gefährden. Prisma® Cloud AI Security Posture Management (AI-SPM) bietet Ihnen mehr Transparenz und Kontrolle über die drei kritischen Komponenten Ihrer KI-Sicherheit: die für Training und Inferenz genutzten Daten, die Integrität Ihrer KI-Modelle und den Zugang zu bereitgestellten Modellen.

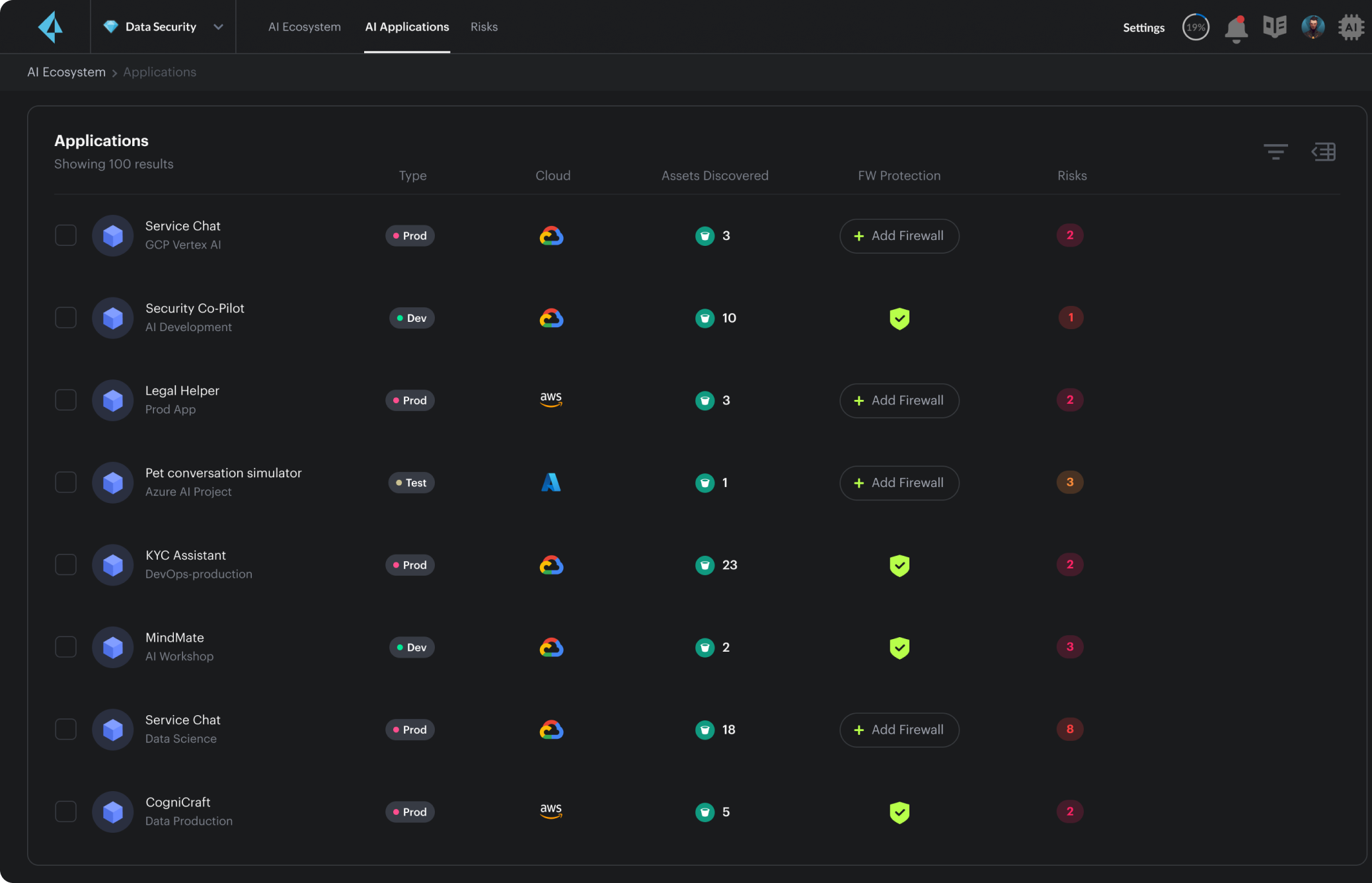

Erstellen Sie einen Katalog aller AI-Anwendungen und ‑Modelle sowie der damit verbundenen Ressourcen. Identifizieren und rekonstruieren Sie die Herkunft der in Ihren Anwendungen genutzten AI-Komponenten.

Katalogisierung von AI-Anwendungs-Stacks

Erstellen Sie einen Katalog aller AI-Anwendungen und ‑Modelle sowie der damit verbundenen Ressourcen.

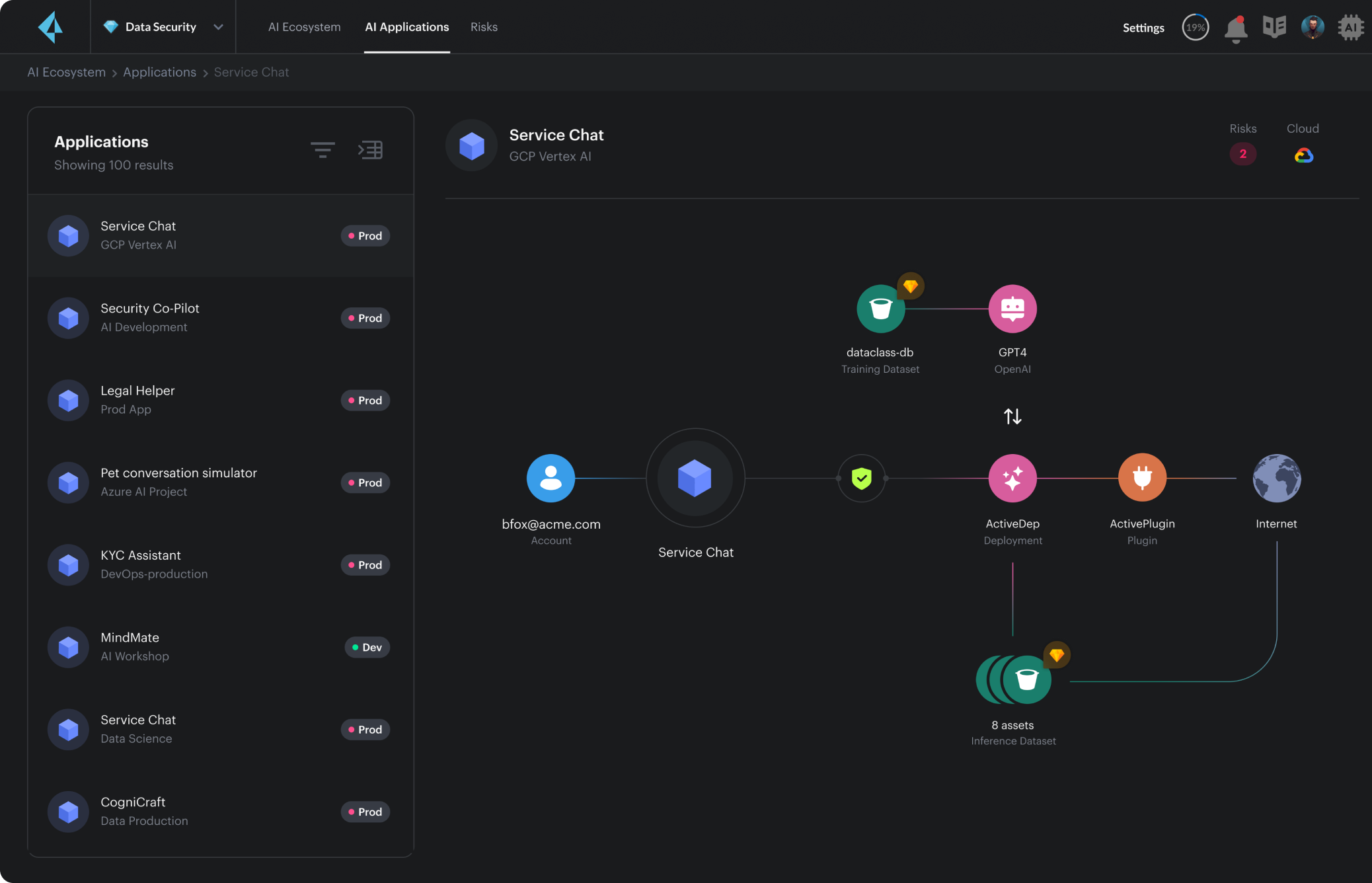

AI-Herkunft

Identifizieren und rekonstruieren Sie die Herkunft der in Ihren Anwendungen genutzten AI-Komponenten und Datenquellen.

Verzeichnis der aktiven Modelle

Katalogisieren Sie die genutzten AI-Modelle und identifizieren Sie Updates.

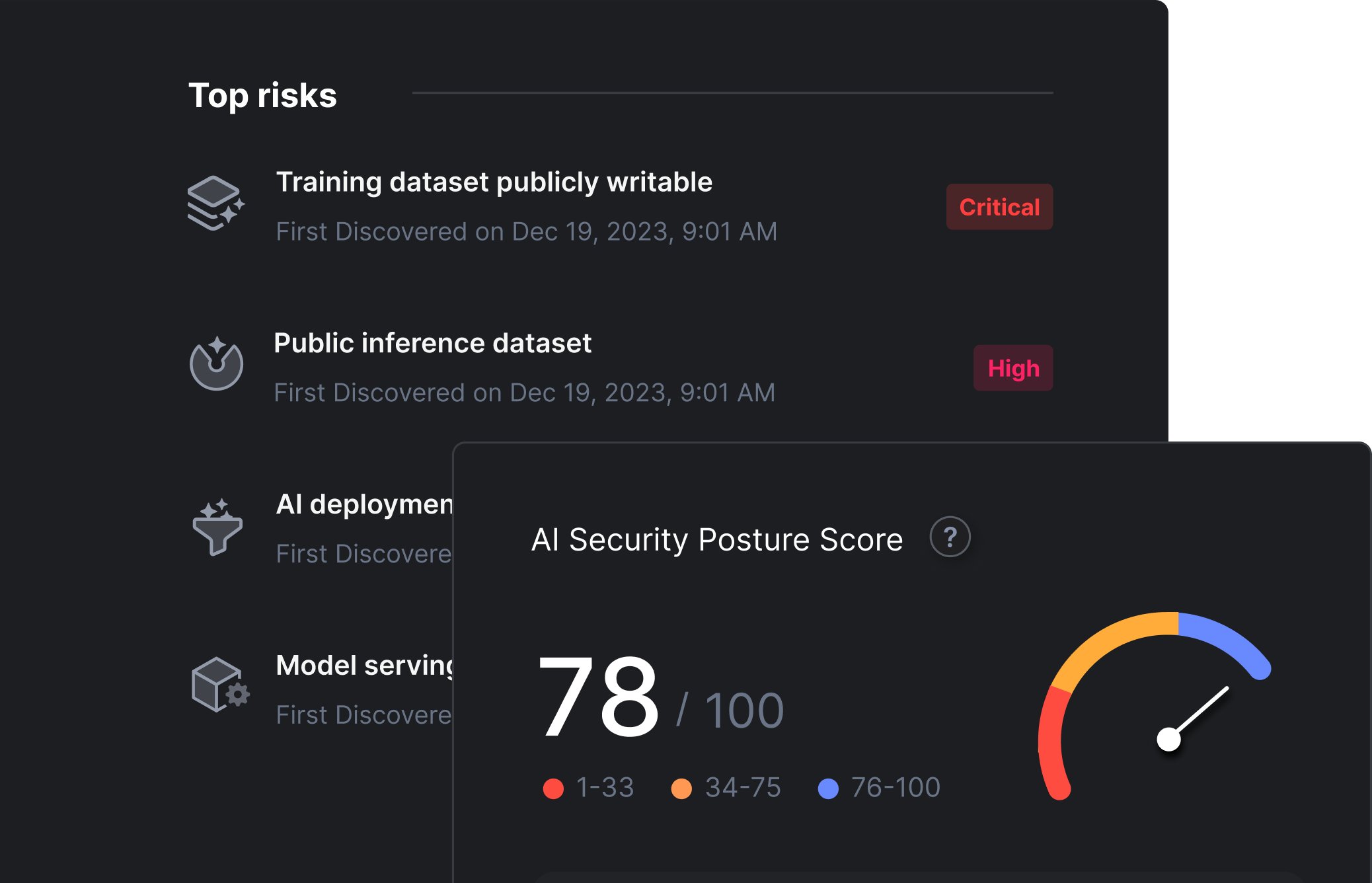

Decken Sie Sicherheitslücken in der AI-Lieferkette sowie Fehlkonfigurationen in AI-Modellen und mit ihnen verbundenen Cloud-Ressourcen auf, die zur Manipulierung, zum Missbrauch oder zum Diebstahl Ihrer Assets genutzt werden könnten.

Prävention von Modellmanipulation und -diebstahl

Ermitteln Sie, ob Angreifer eine Funktionalität nachahmen könnten.

Aufdeckung von Fehlkonfigurationen

Identifizieren Sie Ressourcen und Modelle mit zu weit gefassten Zugriffsrechten.

Vermeidung unsicherer Plug-in-Designs

Identifizieren Sie Agenten/Workloads, die anfällig sind oder zu weit gefasste Zugriffsrechte haben.

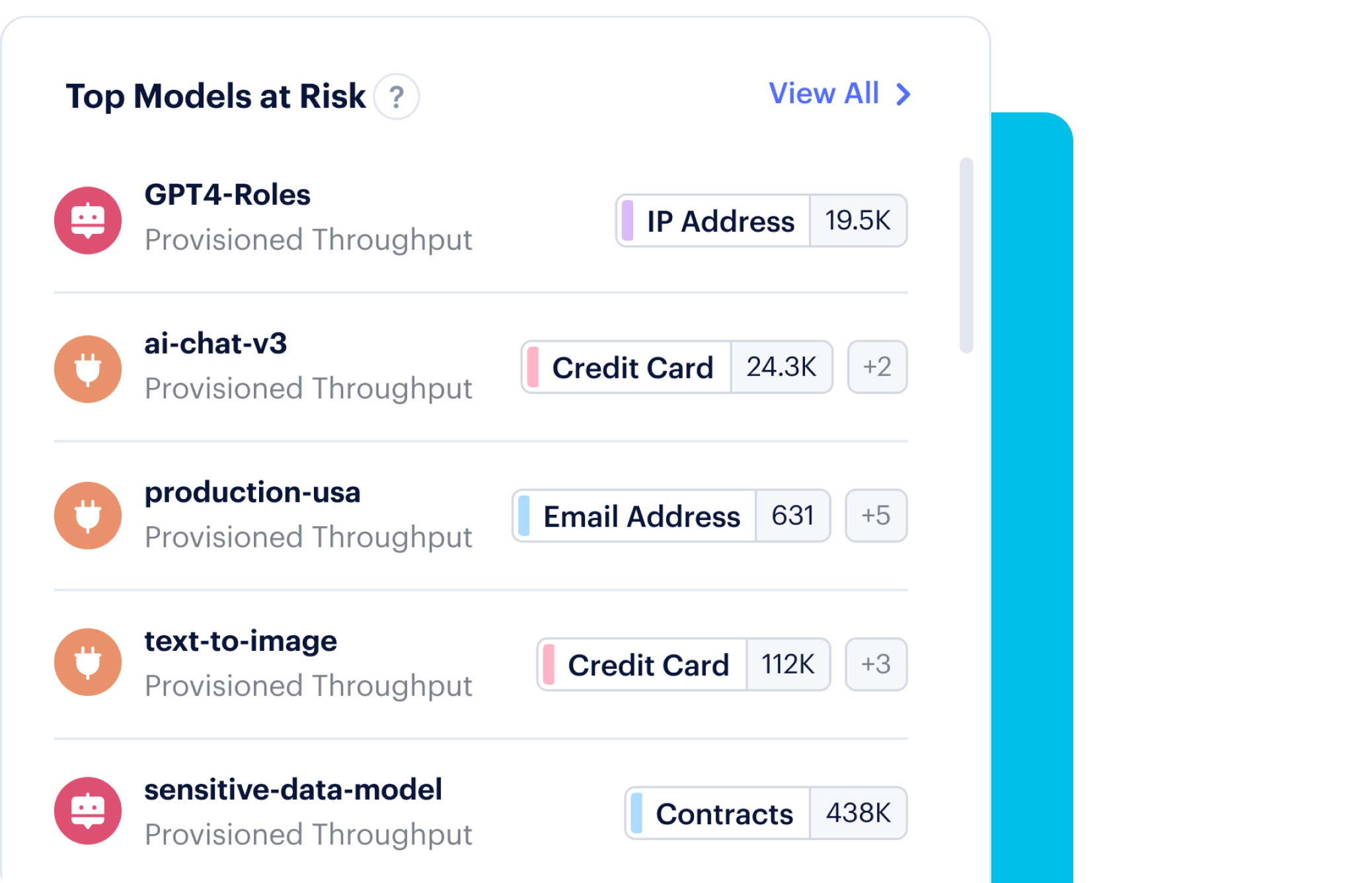

Bei der Bearbeitung von Modelldaten besteht immer das Risiko, dass Sicherheitslücken und Verzerrungen entstehen, Daten offengelegt werden oder Datenschutz-, Sicherheits- oder andere Richtlinien und Compliancevorgaben missachtet werden.

Klassifizierung des AI-Stack

Identifizieren Sie sensible Daten in den von Ihren AI-Modellen genutzten Trainings- und Referenzdaten, Bibliotheken, APIs und Daten-Pipelines.

Überwachung sensibler Daten

Verfolgen und verwalten Sie Datenlecks, das Risiko von Datenmanipulationen sowie Sicherheits- und Datenschutzverstöße.

Priorisierung von Sicherheitslücken

Räumen Sie Sicherheitslücken in Infrastrukturen, in denen AI-Anwendungen mit Zugriff auf sensible Daten gehostet werden, eine hohe Priorität ein.